Wofür steht 'NPU' und wie funktioniert sie? Noch wichtiger – brauchen Sie eine? Diese aufkommende Technologie verändert die Technologielandschaft und hier erfahren Sie alles, was Sie wissen müssen.

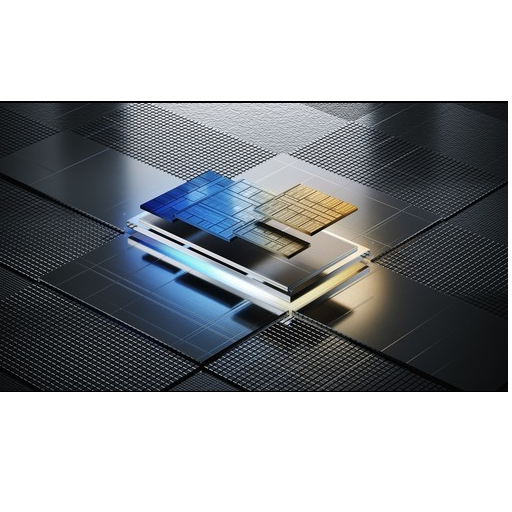

In den letzten Jahren hat sich das Interesse an neuronalen Verarbeitungseinheiten (NPUs) verstärkt. Diese spezialisierten Chips sind seit einigen Jahren in Smartphones enthalten, aber in letzter Zeit haben Unternehmen wie Intel, AMD und Microsoft begonnen, Verbraucher-Laptops und PCs mit NPUs auszustatten, um die AI-Fähigkeiten umfassend zu nutzen.

NPUs sind ein zentraler Bestandteil des Konzepts eines AI-gestützten PCs. Sie werden in die Chips führender Technologiemarken wie AMD, Apple, Intel und Qualcomm integriert. Laptops verfügen inzwischen zunehmend als Standard über NPUs, insbesondere seit Microsoft Anfang dieses Jahres seine Copilot+ AI-PCs vorgestellt hat.

Was macht eine NPU?

Im Wesentlichen ist eine NPU ein Hardware-Beschleuniger, der speziell dafür entwickelt wurde, künstliche Intelligenz-Aufgaben zu bewältigen. Hardware-Beschleunigung bedeutet die Nutzung von spezieller Rechenleistung für spezifische Arbeitslasten – ähnlich wie ein Spezialist in Ihrem Team, während andere sich auf ihre Aufgaben konzentrieren.

NPUs ersetzen weder CPUs (Allzweckprozessoren) noch GPUs (Chips zur Verarbeitung komplexer visueller Daten); vielmehr arbeiten sie mit diesen zusammen. Während CPUs und GPUs ihre Stärken ausspielen, übernehmen NPUs umfangreiche und repetitive AI-Aufgaben, wie das Verarbeiten von neuronalen Netzwerken, und entlasten somit andere Komponenten.

Beispielsweise haben GPUs zwar auch Anwendungen im AI-Bereich, sind jedoch in erster Linie für Grafik-Rendering konzipiert, was sie für reine AI-Aufgaben etwas überqualifiziert macht. Einige Unternehmen, wie Google, entwickeln inzwischen spezifische Lösungen, wie die TPU (Tensor Processing Unit), die speziell auf Arbeitslasten für maschinelles Lernen und AI ausgerichtet ist.

Wann ist Hardware-Beschleunigung notwendig?

Hardware-Beschleunigung, wie sie von NPUs durchgeführt wird, ist für die effiziente Verarbeitung repetitiver und datenintensiver Aufgaben von unschätzbarem Wert. Dies ist besonders wichtig, wenn große Datenmengen schnell verarbeitet werden müssen, wie beim Rendern von 3D-Grafiken oder dem Training von großen Sprachmodellen (LLMs), welche AI-Tools wie Chatbots antreiben.

AI-Arbeitslasten fallen typischerweise in zwei Kategorien:

Training: Dies umfasst das „Lehren“ eines AI-Modells unter Verwendung riesiger Datensätze. Training erfordert leistungsstarke GPUs in großem Maßstab in Rechenzentren.

Inference (Schlussfolgerung): Dies beinhaltet das Anwenden eines trainierten AI-Modells auf neue Daten, wie das Erkennen von Mustern oder das Generieren von Antworten. Solche Aufgaben können in kleinerem Maßstab durchgeführt werden, und hier zeigen NPUs ihre Stärken – sie sind in Ihren Laptop oder PC integriert und ermöglichen eine effiziente, ortsbezogene Verarbeitung.

Wie funktionieren NPUs?

NPUs sind für spezielle Verarbeitungsarten ausgelegt – sie glänzen durch die effiziente Wiederholung von Aufgaben bei großen Datensätzen. Sie verlassen sich auf ein hochgradig paralleles Design, was bedeutet, dass sie viele Aufgaben gleichzeitig bearbeiten können.

Um dies ins Verhältnis zu setzen: CPUs sind Generalisten, die für unterschiedlichste Aufgaben ausgelegt sind, während NPUs wie Spezialisten sind, die sich ausschließlich auf hochdurchsatz- und musterverarbeitungsintensive Aufgaben konzentrieren, wie das Ausführen von neuronalen Netzwerken oder maschinellen Lernmodellen.

Während eine CPU mit wenigen Kernen arbeitet, die Speicherressourcen teilen, hat eine NPU mehrere Untereinheiten, jede mit ihrem eigenen Cache. Diese Konfiguration sorgt für eine hoch optimierte, schnelle Leistung bei Aufgaben wie AI- und neuronaler Netzwerkverarbeitung. Viele Hersteller, darunter Intel und AMD, bieten auch Entwickler-Tools und Softwarelösungen an, um das Potenzial von NPUs zu maximieren, wie zum Beispiel AMDs Ryzen AI Software oder Intels OpenVINO Toolkit.

NPUs und Edge Intelligence

Heutzutage finden sich NPUs zunehmend in Verbrauchergeräten wie Smartphones, Laptops und sogar Wearables. Große Namen in der Tech-Welt, wie Qualcomm mit ihren Hexagon DSP NPUs in Snapdragon-Chips, und Apples Neural Engine in A- und M-Chips, gehen hier mit gutem Beispiel voran. Selbst Unternehmen wie Microsoft haben Copilot+-Laptops mit NPUs eingeführt, um deren AI-Funktionen zu unterstützen.

NPUs beschränken sich jedoch nicht nur auf persönliche Geräte. Sie unterstützen auch die Edge Intelligence – das heißt, Daten werden näher an ihrer Quelle verarbeitet, anstatt sich vollständig auf Cloud-Computing zu verlassen. Diese Fähigkeit ist essenziell für Anwendungen wie das Internet der Dinge (IoT), autonome Fahrzeuge und fortschrittliche Fahrerassistenzsysteme. Durch lokale Datenverarbeitung verringern NPUs die Abhängigkeit von Cloud-Services, was schnellere Reaktionszeiten und höhere Sicherheit verspricht.

Brauchen Sie eine NPU?

Die gute Nachricht ist, dass NPUs zunehmend zur Standardausstattung werden. Unternehmen wie Intel, AMD und Apple haben NPU-Technologie bereits in ihre Chips integriert und Experten prognostizieren, dass bis 2026 100 % der Enterprise-PCs in den USA standardmäßig mit NPUs ausgestattet sein werden.

Wenn Ihr aktuelles Gerät keine NPU besitzt, besteht kein Grund zur Eile, ein neues zu kaufen. Wahrscheinlich wird Ihr nächstes Laptop- oder PC-Upgrade eine NPU enthalten.

Fazit

Neurale Verarbeitungseinheiten entwickeln sich rasch zur Grundlage einer effizienten und zugänglichen AI-Computing-Welt. Sie sind darauf ausgelegt, repetitive, datenintensive Arbeitslasten zu bewältigen, während CPU und GPU für ihre eigentlichen Aufgaben entlastet werden.

Ob Sie AI-Innovationen erkunden, Edge-Computing-Workflows verwalten oder einfach nur die Leistung Ihres PCs verbessern möchten – NPUs werden eine entscheidende Rolle in Ihrer technologischen Zukunft spielen. Da Technologieriesen stark auf diese Technologie setzen, war es nie wichtiger, mehr über NPUs zu erfahren – die kleinen Chips mit dem Potenzial, unsere Nutzung von AI zu revolutionieren.

Schreibe eine Antwort